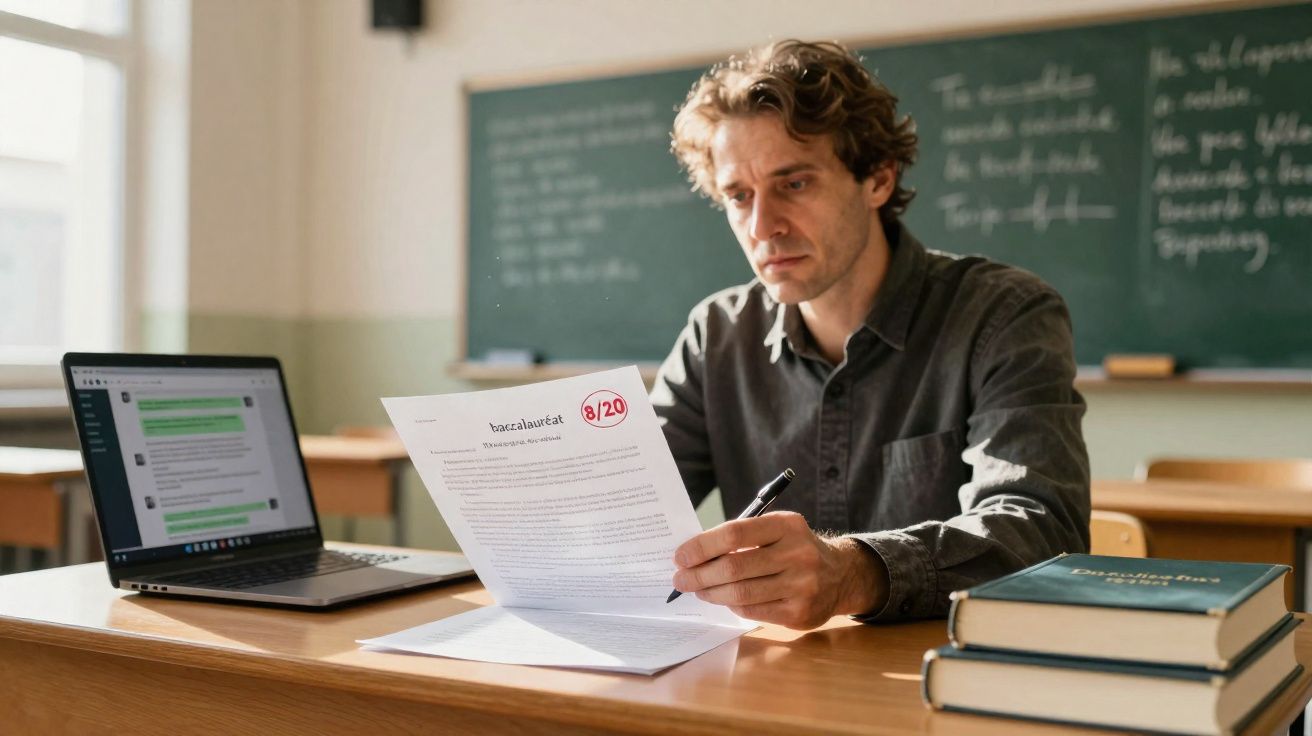

O teste parecia quase uma brincadeira: pedir a um chatbot da OpenAI que respondesse a uma pergunta oficial de redação do baccalauréat, entregar depois a folha a um professor de carne e osso e esperar pela decisão. O texto devolvido parecia limpo, organizado e seguro de si. A nota não correspondeu a essa primeira impressão.

Uma redação impecavelmente formatada, mas vazia por dentro

A experiência foi montada pelo canal regional France 3 Hauts-de-France durante a prova de filosofia do baccalauréat de 2025. Os jornalistas escolheram um enunciado verdadeiro: «A verdade é sempre convincente?» O ChatGPT recebeu a instrução de responder como se fosse um aluno francês do ensino secundário à procura de uma boa nota.

No papel, o resultado cumpria todos os requisitos formais. O chatbot apresentou uma introdução cuidada, um desenvolvimento em três partes e uma conclusão. As frases fluíam bem. A ortografia estava perfeita. Marcadores como «em primeiro lugar» e «por outro lado» surgiam exatamente onde um professor os esperaria.

Visto de longe, a folha do ChatGPT parecia a redação ideal de um candidato nervoso: arrumada, articulada e com uma estrutura tranquilizadora.

Depois disso, os jornalistas enviaram a redação anónima a um professor de filosofia, sem revelar que tinha sido gerada por uma IA. A prova foi corrigida como qualquer outro texto de fim de ciclo. Quando a caneta vermelha terminou o trabalho, a ilusão desfez-se: o ChatGPT obteve apenas 8 valores em 20, muito abaixo da nota normalmente associada à aprovação.

Os comentários do professor concentraram-se menos na forma e mais no conteúdo. Por trás da superfície polida, o raciocínio foi considerado superficial, repetitivo e estranhamente mecânico. A redação dava a sensação de saber como deve ser um texto de filosofia, mas não de perceber o que realmente tem de dizer.

Quando a pergunta muda discretamente de sentido

O primeiro problema sério apontado na correção dizia respeito ao tratamento da própria pergunta. O enunciado original - «A verdade é sempre convincente?» - pede que se averigue se a verdade, pela sua natureza, tem o poder de persuadir. O ChatGPT deslocou subtilmente o centro da questão para outro problema: «A verdade é suficiente para convencer?»

Essa pequena alteração faz enorme diferença num exame. Na correção de filosofia em França, reformular o enunciado com precisão é quase metade do caminho. Mostra que o aluno percebeu a tensão escondida nas palavras.

Ao torcer a pergunta, o chatbot evitou parte da dificuldade - e perdeu pontos por se afastar da intenção do examinador.

A partir do momento em que o tema muda, ainda que ligeiramente, o resto da redação entra no trilho errado. Os argumentos deixam de responder exatamente ao que foi pedido. Para um aluno humano, esse tipo de deslize costuma vir acompanhado de uma consciência dolorosa: sente-se que algo não está certo. Um modelo de IA não experimenta esse desconforto; limita-se a continuar a produzir texto que “soa bem”.

Um plano visível e um pensamento invisível

O professor também criticou a estrutura da redação. No papel, a organização era irrepreensível: secções claramente separadas, frases de ligação e uma conclusão com uma «abertura» para questões relacionadas. Na prática, o plano parecia um molde aplicado de fora, e não o resultado de uma reflexão interior.

Cada parágrafo aparecia como um bloco autónomo, com pouca progressão real de uma ideia para a seguinte. As transições eram formais, mas não propriamente lógicas. A correção descreveu uma sequência de pontos, mais do que um raciocínio em movimento.

- Tese: a verdade deve convencer por definição

- Antítese: a verdade por vezes não convence

- Síntese: outros fatores entram em jogo na persuasão

Esta estrutura clássica em três tempos é muito ensinada nas escolas francesas. O ChatGPT reproduziu-a de forma quase excessivamente fiel, como se estivesse a assinalar caixas num manual. O que faltava, segundo o professor, era a maneira pessoal como um aluno costuma dobrar, deslocar ou reorganizar esse esquema quando está realmente a lutar com uma questão.

Exemplos sem profundidade, conceitos sem definição

Outra fragilidade dizia respeito ao tratamento das noções filosóficas. A redação mencionava ideias como «verdade», «opinião» e «razão», mas quase nunca as definia. Num exame de filosofia, esclarecer estes termos é uma tarefa central. Mostra que o candidato percebe que os conceitos não são apenas palavras, mas ferramentas com contornos próprios.

A IA atirava referências e exemplos para a página como quem faz chamadas de nomes, sem parar para explicar o que significavam ou de que forma sustentavam realmente a argumentação.

Segundo a correção, os exemplos eram muitas vezes genéricos, por vezes gastos pelo uso. Surgiam no fim dos parágrafos como prova decorativa, sem serem aprofundados. Um aluno humano, mesmo com dificuldades, tende a ficar mais tempo preso a um exemplo que lhe diga alguma coisa - uma recordação pessoal, uma notícia, um filme. Esse desvio pequeno pode dar à redação uma marca própria. O texto do chatbot, pelo contrário, soava intercambiável com milhares de outros que poderia gerar a pedido.

Há aqui também uma questão importante de método. Em filosofia, definir os termos logo de início não é um luxo académico: é o que impede que a discussão escorregue para ambiguidades escondidas. Quando «verdade», «convencimento» ou «razão» ficam difusos, a redação pode parecer fluente e, ainda assim, responder a algo diferente do que foi perguntado.

O que isto revela sobre os limites atuais da IA

Não é a primeira vez que sistemas de IA são colocados a fazer exames escolares. Modelos de linguagem já produziram redações para provas britânicas, trabalhos universitários norte-americanos e vários testes nacionais. Muitas vezes, conseguem resultados próximos da nota de passagem em disciplinas mais centradas no conteúdo e até superiores quando a correção privilegia a clareza formal em vez da originalidade.

A filosofia é um teste mais exigente. A disciplina valoriza a dúvida, a hesitação e a tomada de risco conceptual. Pede ao candidato que questione a própria pergunta, que aponte ambiguidades ou pressupostos ocultos. O ChatGPT pode imitar essa postura com frases que parecem reflexivas, mas o professor que corrigiu a cópia não viu uma interrogação genuína por trás das palavras.

O resultado mostra um limite estrutural. Os grandes modelos de linguagem são treinados a partir de padrões presentes em texto. São especialistas em produzir sequências coerentes de frases. Essa competência encaixa muito bem no formato da redação, mas não corresponde necessariamente ao ato de pensar. O modelo liga expressões que costumam aparecer juntas nos dados com que foi treinado. Não verifica essas ligações contra uma experiência vivida de dúvida, confronto ou descoberta.

Também importa lembrar que, numa prova de filosofia, a boa resposta não nasce apenas da rapidez. Muitas vezes, o que distingue uma redação forte é a capacidade de mudar de direção a meio, levantar uma objeção séria e voltar a reformular a tese inicial. Esse movimento é difícil de simular porque depende de uma atenção permanente ao problema, e não apenas ao aspeto exterior do texto.

Porque escrever bem não chega em filosofia

A experiência também expõe uma tensão que os professores já conhecem com alunos humanos: a distância entre estilo e pensamento. Alguns adolescentes dominam truques retóricos, conectores e introduções. Sabem como soar sérios. Ainda assim, as suas redações podem parecer vazias quando se lê para lá da primeira página.

Os professores de filosofia não avaliam apenas o modo como os alunos escrevem; procuram uma mente em ação - a hesitar, a corrigir-se, a empurrar uma ideia mais longe.

O ChatGPT acertou no invólucro exterior desse desempenho, mas não no movimento interno. A sua redação oferecia uma resposta segura e equilibrada, cuidadosamente evitada de afirmações demasiado fortes que pudessem estar erradas. Essa estratégia costuma impedir que a nota despenque, mas raramente produz as classificações altas reservadas a textos ousados e bem defendidos.

O professor que classificou a IA sugeriu que um aluno médio do ensino secundário, mesmo ansioso, poderia ter feito melhor. Um adolescente pode apoiar-se na intuição: uma sensação vaga de que a pergunta «a verdade é sempre convincente» choca com a experiência quotidiana da mentira, da manipulação ou da recusa obstinada em aceitar factos. A partir daí, consegue construir argumentos moldados pelas suas próprias vivências. O chatbot não tem esse fundo; dispõe apenas de texto que absorveu estatisticamente.

Em contexto de sala de aula, isto também ajuda a perceber porque é que o oral continua a ser tão importante. Quando um professor pede a um estudante que defenda uma posição, responda a uma objeção ou reformule um argumento no momento, a linguagem deixa de ser apenas acabamento e passa a ser pensamento em tempo real. É precisamente aí que as respostas automáticas ficam mais expostas.

O que significa 8 em 20 no sistema francês

Para quem está fora de França, a classificação merece uma breve explicação. O baccalauréat é cotado numa escala de 0 a 20. Um 10 costuma equivaler a uma aprovação básica. Notas entre 12 e 14 são vistas como razoáveis. A partir de 16, entra-se no território das redações muito fortes.

| Pontuação /20 | Significado aproximado na correção de filosofia |

|---|---|

| 5 ou menos | Pergunta mal compreendida ou quase ausência de argumentação |

| 8 | Alguma estrutura e algumas ideias, mas entendimento fraco do problema |

| 10–12 | Redação correta e convencional, com raciocínio claro mas limitado |

| 14–16 | Análise forte, referências pertinentes, posição pessoal nítida |

| 17–20 | Textos raros que juntam rigor, originalidade e profundidade |

Com 8 valores, o ChatGPT provavelmente não reprovaria no exame inteiro, graças às compensações de outras disciplinas. Mas em filosofia, onde muitos alunos procuram pelo menos um 10 ou 12 respeitável, dificilmente seria visto como um êxito.

Implicações para os alunos tentados a delegar as redações

A experiência da France 3 surge num momento delicado para as escolas. Professores em toda a Europa e na América do Norte já suspeitam que alguns alunos recorrem a ferramentas de IA para elaborar trabalhos de casa ou até exames feitos em casa. A ideia de entregar a redação de filosofia a um assistente conversacional é compreensivelmente tentadora para um adolescente diante de uma página em branco.

Este caso deixa uma mensagem ambígua. Sim, o ChatGPT consegue produzir em segundos algo que parece uma boa cópia. Não, isso não garante uma boa classificação quando um especialista lê com atenção. Mais do que isso, depender desse apoio traz riscos que vão para lá da nota.

- Os alunos podem deixar de praticar o trabalho lento e frustrante de construir os seus próprios argumentos.

- Podem perder confiança na capacidade de escrever textos imperfeitos, mas autênticos.

- Os professores podem responder reforçando a vigilância, o que corrói a confiança na sala de aula.

Alguns educadores defendem um caminho intermédio: usar a IA como parceira de exploração de ideias, e não como autora invisível da resposta. Um aluno pode pedir a um chatbot definições de «verdade» em diferentes tradições filosóficas e depois usar essa informação de forma crítica, confirmando fontes e construindo a sua própria posição. Nesse cenário, a classificação reflete a forma como o estudante escolhe, adapta e questiona aquilo que a ferramenta oferece.

Na prática, uma utilização mais sensata destas ferramentas passa muitas vezes por pedir esquemas, perguntas de treino ou críticas a um rascunho próprio, em vez de delegar a redação inteira. Quando a IA ajuda a organizar o pensamento sem o substituir, o exercício continua a ser do aluno.

Para lá do bac: o que conta como «pensar» nas máquinas?

A modesta nota de 8 em 20 também alimenta um debate mais amplo sobre inteligência artificial. Quando se diz que «o ChatGPT pensa», muitas vezes quer-se apenas dizer que produz texto que se parece com pensamento. A redação do baccalauréat lembra-nos que parecer pensamento e pensar de facto não são a mesma coisa.

Para tornar essa distinção mais clara, alguns investigadores usam os termos «sintático» e «semântico». As capacidades sintáticas dizem respeito à forma: gramática, estrutura, expressões típicas que parecem lógicas. As capacidades semânticas dizem respeito ao significado: a forma como as ideias se ligam à realidade, à experiência e à ação. Os grandes modelos de linguagem são excelentes no plano sintático. O seu domínio semântico é mais frágil, sobretudo em áreas como a filosofia, onde a realidade não é apenas física, mas também conceptual.

É possível que sistemas futuros reduzam essa distância, talvez através da integração de outros tipos de dados ou de módulos de raciocínio mais robustos. Por agora, um professor francês de 2025 com uma pilha de redações de filosofia em cima da secretária ainda consegue distinguir entre um adolescente a lutar com uma questão e um chatbot a alinhar frases familiares. Pelo menos neste momento, a caneta vermelha continua teimosamente humana.

Comentários

Ainda não há comentários. Seja o primeiro!

Deixar um comentário